Contributions

2. Related Work

3. Preliminaries

我们主要考虑两种设定:上下文老虎机/Contextual Bandits 设定和模仿学习/Imitation Learning 设定。

3.1 Contextual Bandits Setting

Contextual Dueling Bandit 下,我们假设有一个 Context Set 和一个动作空间 。在每一轮 中,环境会对抗性的/Adversarially 选择一个上下文 ,学习者的任务是决定是否向专家发起查询。如果决定查询,就选择一个动作对 ,随后会收到一个 带噪声的反馈 ,指示 和 哪个更好。

形式化来讲,我们假设专家依赖于一个偏好函数/Preference Function 。基于这个偏好函数,其带噪声的反馈 按照下述方式进行采样:

其中 是链接函数/Link Function,其满足 。如果学习者不进行查询,它仍然需要选择一对动作,但是不受到任何反馈, 指示学习者是否在第 轮进行了查询。对于偏好函数,其一般要假设满足一定的关于序关系的性质:

Assumption:我们假设 在函数类 中,且函数类 中的所有函数都满足以下两个性质:传递性/Transitivity,对于任何上下文 和动作 ,如果 且 ,那么 ;反对称性/Anti-symmetry,对于任何上下文 和动作 ,有 。

传递性意味着偏好是可以排序的,反对称性决定了偏好方向的一致性,即如果 比 好,那么 一定比 ,这就避免了回环,因此最优摇臂一定存在。最优臂定义位对于任意 和上下文 ,存在一个臂 ,使得对于任意臂 都有 。我们将这个最佳臂不失一般性地记为 。

我们直接可以将偏好函数 建模为奖励差值的形式:假设存在一个奖励函数 ,我们直接定义 。在这种情况下,通常会选择 ,这对应了 Bradley-Terry-Luce/BTL 模型,在实践中这样的模型用于学习奖励模型。

对于上下文老虎机设定,学习者的目标是最小化遗憾/Regret 和查询次数/Queries,定义如下:

3.2 Imitation Learning Setting

Imitation Learning 设定中,我们考虑一个有限视界/Finite-Horizon 的 MDP,由元组 定义,其中 是状态空间, 是动作空间, 是转移函数, 是奖励函数, 是每一集的长度。

交互过程如下面所述:在每一集 开始时,学习者接收到一个初始状态 (这也可以是对抗的)。然后,学习者与环境交互 步。在每一步 ,学习者首先决定是否进行查询。如果进行查询,学习者需要选择一对动作 ,随后会收到一个反馈 ,指示从专家角度看哪个动作更优。这里的反馈采样自:

剩余基本上和在 Contextual Bandits 设定中一样,无论学习者是否进行了查询,它随后都会从 选择一个动作并转移,在 步之后,下一集开始。 指示学习者是否决定在第 集的第 步进行查询。我们假设函数空间 是 个类的乘积,即 ,其中对于每个 ,我们使用 来建模 ,并假设 满足传递性和反对称性假设。

策略/Policy 是一个映射 。对应定义价值函数和动作价值函数。在模仿学习设定下,我们假设专家具有一个马尔可夫策略/Markov Policy ,并且专家的偏好依赖于 下的后续累积奖励/Reward-to-Go 来决定偏好,形式化讲就是 。因此,学习者的目标仍然是最小化遗憾和查询次数:

3.3 Link Function and Online Regression Oracle

我们一般假设 是某个 -强凸函数 的导数,并将相关联的损失函数定义为 。此外,我们的算法利用了一个在线回归预言机/Online Regression Oracle,在线地输出一个函数 ,对于任意数据序列在 上具有次线性的遗憾保证:

Assumption:我们假设学习者可以使用一个 Online Regression Oracle,对于任意序列 ,这里序列每一项的标签 生成自 ,我们有:

这里的上界 相对于 次线性增长。若上下文清晰,我们定义 。这里的 代表遗憾上界,在许多情况下通常是 或函数类 复杂度/大小的对数阶。

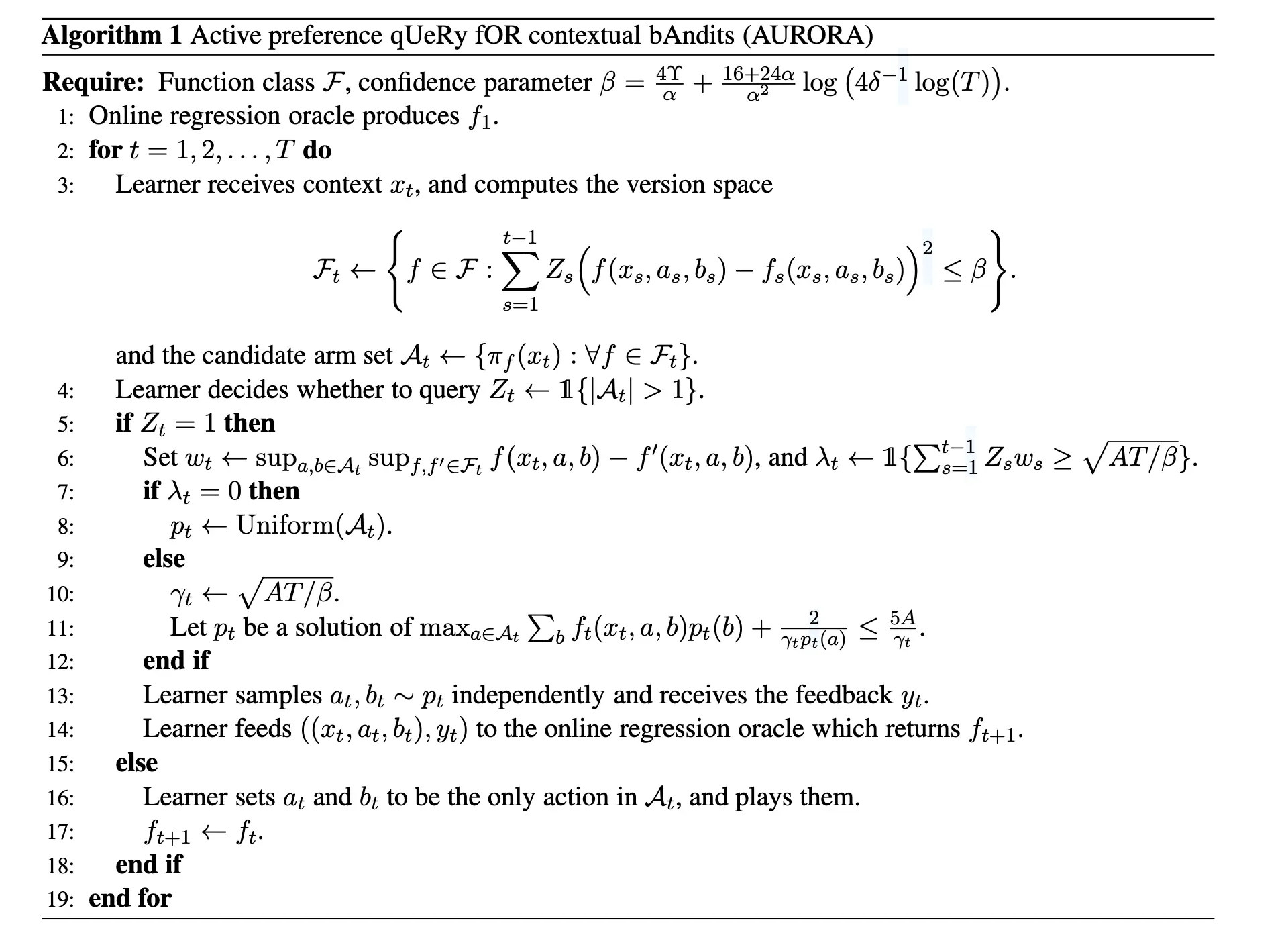

要理解这里的设计,我们需要先了解算法的机制:算法大致流程是在每一轮 之前都可以得到一个偏好函数 ,然后基于这个函数计算出版本空间/Version Space 与候选摇臂集/Set of Candidate Arms ,随后基于这些集合来计算不确定度及其阈值,从而决定是否进行查询。在决定查询之后,才可以获得该轮的反馈 ,并将 添加到数据集中,进而根据 Oracle 来得到新一轮的偏好函数 。

因此,Oracle 需要设计为在线地最小化某种回归损失,而不是朴素的经验风险最小化,其遗憾是相对于整个在线学习过程的,计算每一轮老的偏好函数 在新数据点 上的损失,进而拥有根据数据迭代和预测未来的能力。这样的设计使得算法和理论均模块化,

4. Algorithm on Contextual Dueling Bandits

AROURA 算法原为 Active Preference Query for Contextual Bandits 算法,在每一轮 中